Retour sur le projet OpenAI lancé en 2015

Lancée fin 2015 à San Francisco, la société OpenAI est le fruit du cerveau d’Elon Musk (entre autres). Composé aujourd’hui d’une équipe de près de 120 personnes travaillant exclusivement sur le développement d’intelligences artificielles, OpenAI a été doté par Microsoft (partenaire stratégique) d’une enveloppe de 1 milliard de dollars pour lancer les hostilités et tenter d’accélérer sur un sujet où aujourd’hui Google & Facebook ont un train d’avance (Amazon & IBM restent des outsiders).

Initialement définie comme un organisme à but non lucratif, OpenAI a changé de statut en mars 2019 pour devenir une structure à but lucratif plafonné nommée OpenAI Limited Partnership un modèle hybride limitant les rendements des premiers investisseurs à 100 fois leur investissement. Ce changement s’est opéré au regard des avancées majeures en intelligence artificielle de l’équipe et des débouchés commerciaux gigantesques qui sont apparus.

OpenAI travaille sur plusieurs projets en parallèle, dont les plus importants sont DALL-E & GPT-3 qui font partie d’une branche de l’IA : « les modèles de génération (Generative models) ».

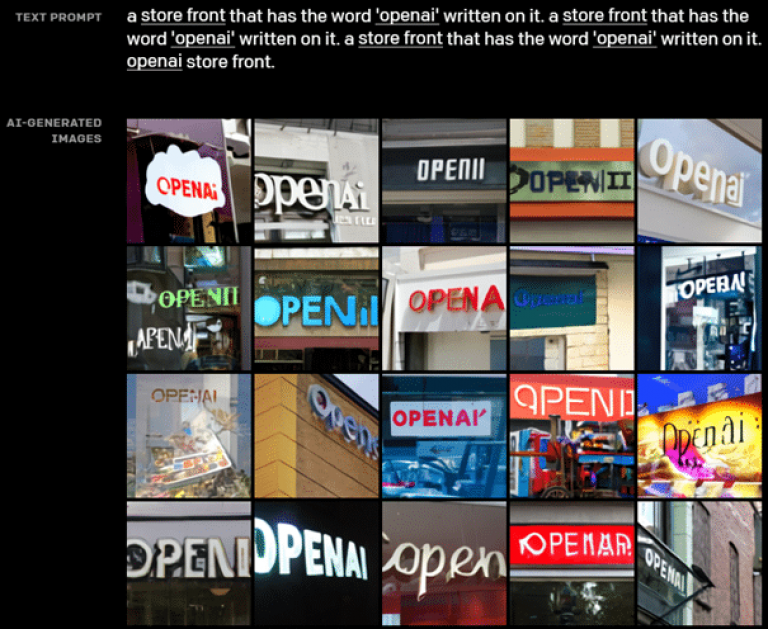

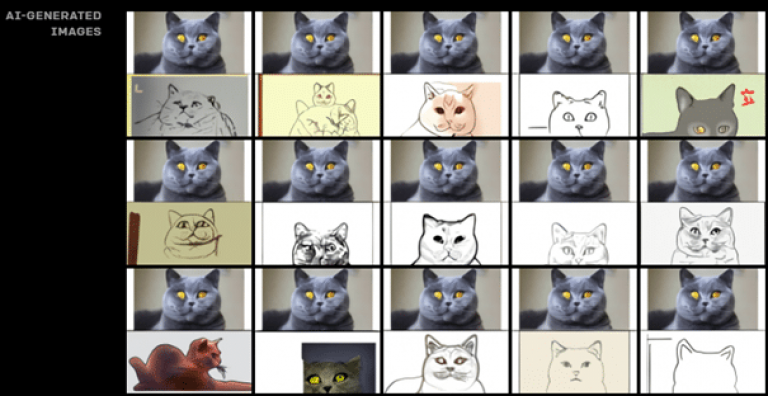

Sans s’étendre, sachez juste que DALL-E, révélé par OpenAI le 5 janvier 2021, est une IA de génération d’images. Elle permet la création automatisée et non guidée d’images à travers un contexte fourni (une phrase ou une autre image par exemple). Elle est basée sur la compréhension sémantique d’une déclinaison de GPT-3.

« une devanture de magasin intégrant le mot OpenAI écrit dessus »

Fiche d’identité : Open AI GPT-3

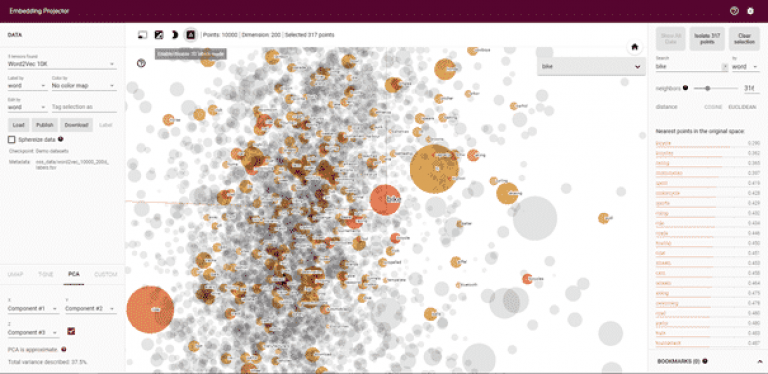

GTP-3 pour « Generative Pre-trained Transformer 3 » est une intelligence artificielle pré-entrainée de compréhension et de génération de langage créée par OpenAI et lancé officiellement le 28 Mai 2020. Elle est, à ce jour, dotée de la technologie de « word embedding » la plus complexe du monde.

(NB, le word embedding est une technologie utilisée dans l’IA et se traduit par une vectorisation sémantique : chaque mot possède des coordonnées et la proximité des mots dans l’espace traduit le fait qu’ils sont proches dans l’usage : le mot « bike » est relativement proche des mots « rider » et « bicycle » par exemple, un peu plus éloigné des mots « cowboys », « skating » et encore plus éloigné des termes « rainbow », « audi » ou « bluetooth ».)

Cet algorithme a été entraîné, de manière autonome, à partir d’une quantité très importante de textes collectés essentiellement sur internet, provenant notamment de Wikipedia et de l’ensemble de données CommonCrawl (organisation qui scanne et archive le web depuis 2012, disposant de près de 3.1 milliards de pages web dans ses archives).

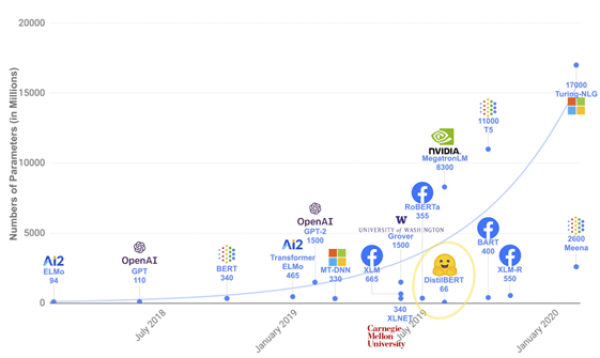

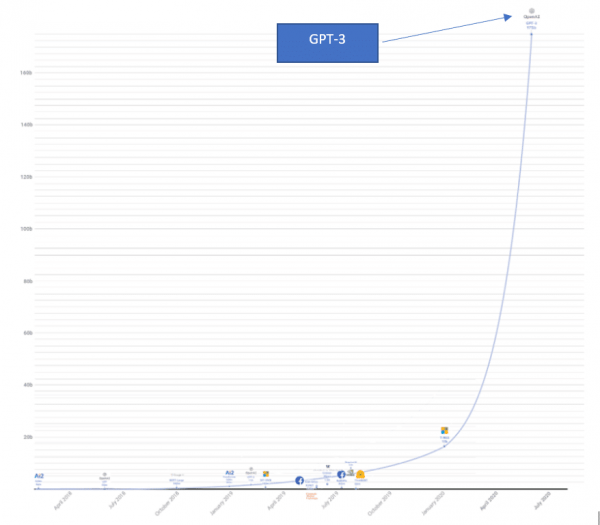

GPT-3 est une amélioration de GPT-2, qui déjà était capable de comprendre et de rédiger du contenu de manière automatisée sur la base de 1,5 milliard de paramètres, GPT-3 est lui basé sur 175 milliards de paramètres. Cette course au gros chiffre illustre le nombre de critères (poids) exploités par le modèle d’IA sémantique pour trouver la réponse en sortie (De manière simplifiée, GPT-3 a été entrainé en faisant varier 175 milliards de paramètres pour prédire ses résultats)

Afin de se rendre compte de l’avancée technologique que représente GPT-3, ci-dessous 2 graphiques qui vous montrent l’évolution dans le temps des modèles d’IA et l’évolution du nombre de paramètres :

IA sémantique : quels sont les usages de GPT-3 aujourd’hui ?

« IA sémantique » Ok, mais à quoi servent concrètement ces milliards de paramètres de technologie ? Quelles problématiques GPT-3 va-t-il résoudre dans notre quotidien ?

GPT-3 est distribué aujourd’hui par OpenAI sous la forme d’un portail web qui permet d’interroger l’intelligence artificielle. Les entreprises commencent tout juste à en imaginer les centaines de cas d’usages dans leurs contextes.

Les usages de GPT-3 sont vastes. On peut imaginer, dès aujourd’hui, l’utiliser pour :

- Générer des contenus éditoriaux: articles, discours, livres…

- Générer des contenus pour le référencement naturel (SEO) : L’usage de GPT-3 pour le référencement naturel (SEO) est intéressant. Il peut permettre de concevoir des cocons sémantiques ou encore des articles de blogs au regard des mots clés les plus à fort trafic afin d’améliorer la présence d’un site sur les pages de résultats des moteurs de recherche.

- Générer des contenus marketing à vocation publicitaire : Nourri d’insights marketing, GPT-3 peut permettre la création automatisée d’argumentaires produits ou encore d’annonces publicitaires personnalisées.

- Répondre à des questions générales : GPT-3 peut apporter des réponses simples sur la base des données publiques assimilées lors de son entrainement.

- Générer du code informatique: Microsoft a soutenu le lancement de GitHub coPilot (https://copilot.github.com/) en Juillet 2021. Cet assistant révolutionne la génération de code informatique, tout langage de programmation confondu, en aidant les développeurs à écrire le code de manière semi-automatisée. Sur la base d’une intention, Github coPilot, détermine le meilleur code à écrire. Pour réussir cela, coPilot exploite la base CODEX de données d’OpenAI, qui n’est qu’une version allégée du GPT-3 d’OpenIA.

- Synthétiser des grands volumes de contenus: Par l’analyse sémantique d’un document ou de milliers de documents, l’IA sémantique est capable de produire un résumé synthétique de la matière analysée.

- Retranscrire des intentions saisies par un utilisateur (humain ou non) pour aider d’autres IA dans les tâches, comme avec DALL-E, pour faire de la génération d’images, ou encore avec des outils de wireframing comme Figma pour imaginer des interfaces graphiques, respectant les bonnes pratiques UX et tout ça, sur la compréhension d’un contexte (« Je veux un site internet adapté à un mobile avec un carrousel d’images, un formulaire de contact et des contenus »).

L’avis de Rémi Bacha, consultant & formateur en data science – https://labsonmars.fr : « GPT-3 va permettre de répondre à de nombreux cas d’usages pour les entreprises, toutefois, il ne faut pas oublier que l’IA est spécialisée pour répondre aux tâches liées au langage uniquement. GPT-3 ne sait pas faire de maths par exemple et ne pourra jamais faire de prévision de ventes par exemple. On note que des alternatives Open Source existent déjà sur des modèles de génération de textes, on peut citer PEGASUS ou BARThez en résumé de texte. Il faut aussi comprendre que GPT-3 est ce qu’il se fait de mieux aujourd’hui, mais le monde de l’IA avance à une vitesse folle – on parle déjà de l’IA « Wu Dao », un nouveau modèle d’intelligence artificielle qui embarquerai plus de 1700 milliards de paramètres développés en ce moment par la Chine, soit 10 fois plus que GPT-3, le champion américain. On parle aussi d’un futur GPT-4 qui serait en préparation… Dans ce contexte, on comprend que pour tirer partie de ces technologies, il faut repenser une organisation adaptée en entreprise avec une agilité forte pour se remettre régulièrement sur les rails des meilleures IA. Toutefois, à la vue des bénéfices que cela tire, il devient de moins en moins concevable de faire sans. Au tour des entreprises de s’approprier l’IA pour en tirer des points de marge et des bénéfices nouveaux. »

Exemple de l’utilisation de GPT-3 pour générer des maquettes de site internet sous FIGMA :

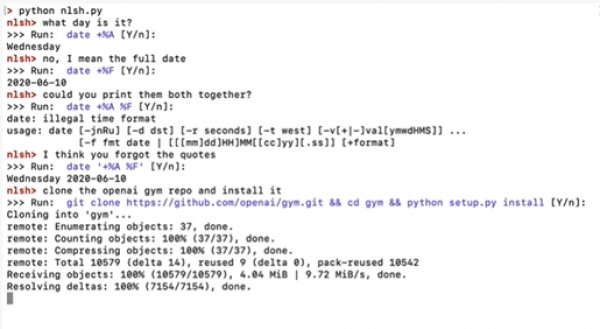

Exemple de l’utilisation de GPT-3 pour interpréter des intentions et générer du code automatiquement :

Quelles sont les limites de GPT-3 d'OpenAI?

A l’heure où nous écrivons cet article, on notera que GPT-3 est en version « beta » pour le grand public, probablement le temps pour OpenAI de trouver des réponses à certaines limites actuelles de la solution, qui restent des freins à une adoption massive de l’IA :

- Son modèle économique: l’usage de GPT-3 est coûteux. Cela fonctionne sous la forme de crédits à acheter par mots générés : comptez 5 centimes d’euros les 750 mots.

- La langue : GPT-3 ne comprend et ne crée du contenu natif qu’en anglais pour le moment. A travers des dictionnaires de traduction, il est possible d’utiliser GPT-3 dans toutes les langues, toutefois la traduction se fait parfois ressentir.

- La donnée d’apprentissage : GPT-3 a été entrainé avec des centaines de Giga octets de données datant du début du web jusqu’en Octobre 2019. Par conséquent, toutes les informations & expressions récentes sont encore inconnus de l’IA. GPT-3 ne connait pas le COVID 19 par exemple ! On peut imaginer que les équipes d’OpenAI travaille sur un ré-entrainement dans le futur et/ou sur un mode d’apprentissage différentiel

- L’éthique, comme toutes les IA basées sur des modèles de génération, la question se pose sur la transparence et la déontologie des contenus générés. Loin de régler ce point, OpenAI avance en intégrant progressivement des listes de mots interdits. De plus, via le modèle d’utilisation de GPT-3, exclusivement en ligne & nécessitant la création d’un compte, OpenAI reste maitre de l’usage qu’en tire chaque utilisateur sur la plateforme en s’octroyant le droit d’archiver les entrées et les réponses en sorties.

Il fait nulle doute qu’OpenAI apportera des réponses à ces limites dans les mois à venir : abonnement sur-mesure, gestion multi-langue et apprentissage en continue du web devraient apparaitre comme des fonctionnalités futures de GPT-3.

L’avis d’Emmanuel Chauvin, expert NLP chez BNP Paribas Securities Services : « La révolution de ces dernières années a été apportés par l’amélioration des outils de NLU (Natural language Understanding). Capter une intention avec toutes les subtilités que le langage humain peut y injecter pour finalement la retranscrire « informatiquement parlant » est une prouesse technique et technologique. Les modèles d’IA de compréhension et de génération de langage sont aujourd’hui des accélérateurs pour les entreprises pour faire de la traduction, du résumé, de la correction de texte, répondre à des questions plus précisément et plus rapidement que n’importe quel humain en entreprise…

GPT-3 est certes l’IA de génération de texte reconnue comme la plus « performante » à ce jour mais d’autres modèles existent sur le marché ; on citera les initiatives de Google autour de la compréhension des intentions des utilisateurs pour son moteur de recherche, comme l’algorithme Google MUM, évolution de Google BERT ou encore RoBERTa de Facebook AI (basé sur Google BERT) »

Et l’humain en 2025 dans tout ça : adieu le métier de graphiste, de community manager, de développeur,...?

Avec l’arrivée de modèles d’IAs de génération de texte toujours plus performants, on peut tenter d’imaginer les changements majeurs à voir venir d’ici quelques années pour nous, êtres humains travailleurs du web (entre autres, mais pas que).

A l’horizon 2025, on projette :

- de nouveaux emplois autour de la data science évidemment – il faudra de plus en plus de spécialistes capables de « comprendre et de justifier » les choix de l’IA, faire varier les paramètres pour obtenir les meilleures réponses possibles, améliorer continuellement les algorithmes, implémenter les solutions au sein des entreprises pour en tirer les bénéfices, relire et valider ce qui aura été généré…

- Mais également un potentiel impact fort sur de nombreux emplois d’aujourd’hui qui seront amenés à évoluer. Les concepteurs-rédacteurs devront faire « avec l’IA » et pas « contre l’IA » ; les développeurs informatiques devront également côtoyer ces outils pour générer du code plus rapidement, plus optimisé, plus performant ; Les conseillers clientèles, déjà impactés depuis quelques années avec l’arrivée des agents conversationnels (type chatbot), l’amélioration des IA de NLP vont progressivement être capable de comprendre toutes les questions, d’apporter l’ensemble des réponses & traiter les demandes des clients ; Plus les algorithmes évolueront et se spécialiseront par langues, plus les traducteurs devront faire évoluer leur métier ; Les journalistes n’auront peut-être plus besoin d’écrire leurs articles, l’IA se chargera de compiler toute la matière disponible en temps réel pour en faire un résumé concis…

On a toujours eu ce sentiment que l’intelligence artificielle pouvait remplacer l’humain. Avec GPT-3 et les performances qu’il démontre, on a devant nous un « outil » qui peut changer les usages et modifier notre quotidien. Complété par le fait que les acteurs de la Silicon Valley accélèrent depuis quelques années également sur la production de puces informatique fait pour l’IA (IA by-design) : le TPU (Tensor Processing Unit) ; On obtient alors un couple « software/hardware » avec des performances en vitesse de traitement et en qualité de sortie jamais égalés jusqu’alors et dont on a du mal à déterminer les limites.

Pour aller plus loin :

- https://gpt3demo.com/ => annuaire listant les outils/initiatives utilisant GPT-3

- https://contentbot.ai/ => met à disposition une interface exploitant GPT-3 pour rédiger tout type de textes

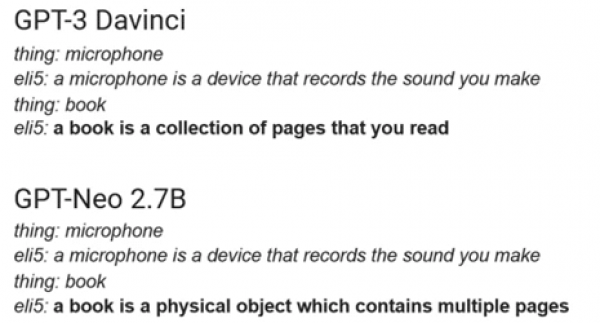

- https://huggingface.co/models?pipeline_tag=text-generation => annuaire référençant des modèles d’IA utilisables. On y retrouvera l’IA open-source GPT-NEO, basé sur la même base de connaissance que GPT-3 mais avec une architecture de 2,7 milliards de paramètres (vs les 175 milliards de GPT-3 « DaVinci »)